Производительность софт NVMe рейдов на основе mdadm, LVM и ZFS при использовании iSER и NVMe-oF (100G version) — Part 2

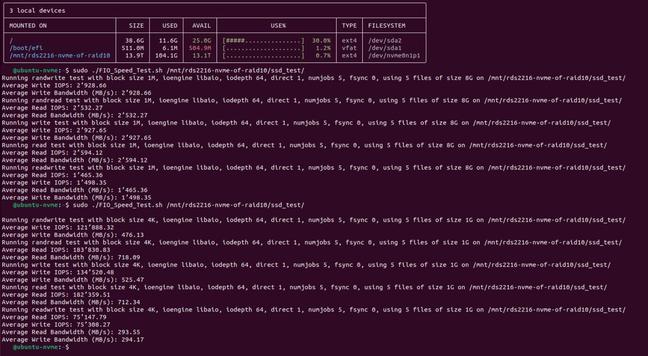

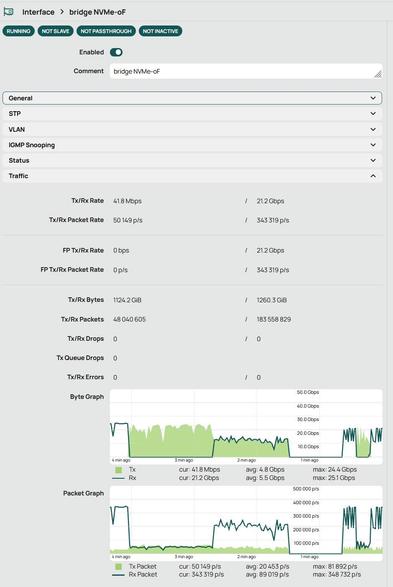

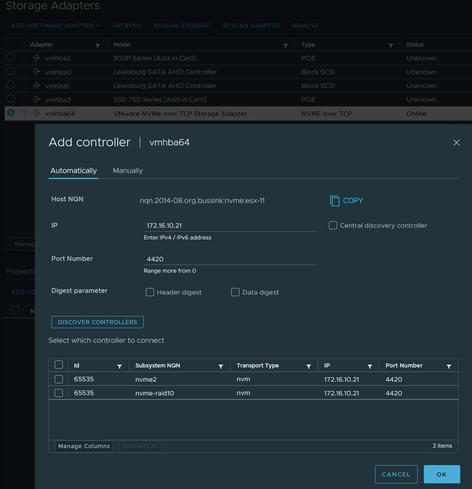

Продолжение первой части, смысл данной статьи сохраняется, а именно показать максимальную производительность, когда вопрос сохранности данных решается репликами или бэкапами. Цель - протестировать производительность трёх систем объединения физических устройств в одно логическое систем при использовании iSER и NVMe-oF. Так как статья получилась объёмная, она поделена на 2 части. В этой части - тесты с использованием HCIbench и iSER\NVMe-oF

Производительность софт NVMe рейдов на основе mdadm, LVM и ZFS при использовании iSER и NVMe-oF (100G version) — Part 2

Предисловие скопировано из Part 1. С момента прошлой статьи прошло 2 года (и за время написания статьи ещё полгода), за это время: количество дисков в системе увеличилось до 8 PM9A3...