Shared Geometry of Neural Networks

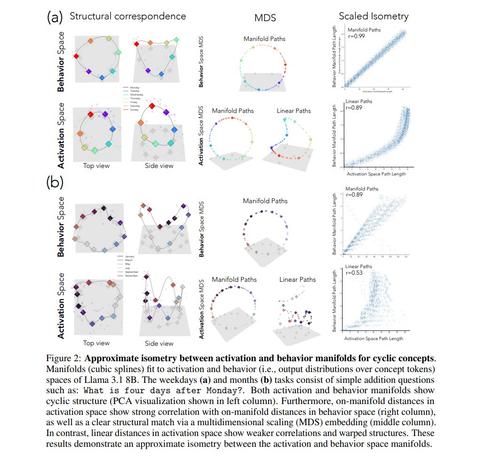

최근 연구 'Manifold Steering'은 신경망 내부 표현과 행동 결과 사이의 인과 관계를 활성화 매니폴드 상에서 개입함으로써 분석한다. 이 방법은 기존의 선형 개입 방식보다 자연스러운 신경망 동작을 더 잘 복원하며, LLM과 비디오 월드 모델 모두에서 검증되었다. 신경망의 동작을 제어하고 디버깅하는 데 있어 신경 기하학적 구조가 핵심 메커니즘임을 제시한다. 이는 신경망의 내부 작동 원리를 이해하고 AI 모델 제어 기술 발전에 중요한 시사점을 제공한다.

https://twitter.com/TheAITimeline/status/2053712704104206729

#neuralnetworks #manifold #llm #modelinterpretability #representationlearning

The AI Timeline (@TheAITimeline) on X

Manifold Steering Reveals the Shared Geometry of Neural Network Representation and Behavior Author's Explanation: https://t.co/ax8HuhezQw Overview: Manifold steering investigates the causal link between internal representations and behavioral outcomes by intervening along