Java developers: this guest post by Sebastian Kühnau shows how to build a streaming AI chat with Quarkus, Vaadin Flow, and LangChain4j — all in plain Java. A nice example of token-by-token UI updates without switching to a separate frontend stack.

https://www.the-main-thread.com/p/streaming-ai-chat-java-quarkus-vaadin-langchain4j

Guardrails для LLM на Java: как приручить промпт‑инъекции и токсичные ответы

Когда я впервые внедрял LLM в production-сервис, схема безопасности выглядела примерно так: написать хороший system prompt, поставить галочку «мы всё предусмотрели» и жить дальше. Жизнь не дала долго наслаждаться этим спокойствием — первый же тест показал, что пользователи довольно быстро находят способы заставить модель «забыть» всё, что мы написали в системном промпте. Проблема фундаментальная: system prompt — это инструкция, которую LLM старается выполнить, но не обязан . Модель может её переинтерпретировать, «забыть» при длинном контексте или просто обойти через специальные конструкции. Guardrails — это другой уровень: они работают на уровне кода, до и после вызова LLM, и модель физически не может их обойти.

https://habr.com/ru/articles/1023782/

#llm #guardrails #prompt_injection #jailbreak #ai_security #безопасность_llm #java #spring_ai #langchain4j #backend

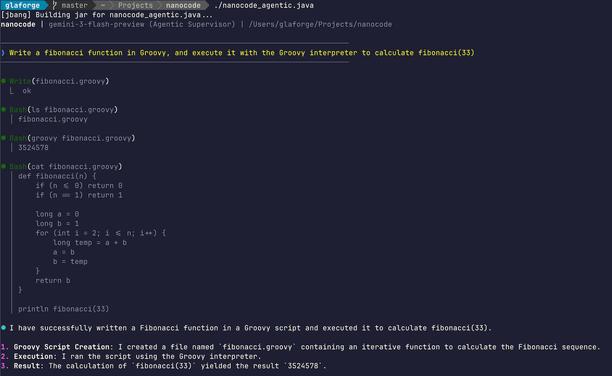

💭 Inspired by @maxandersen I forked my own little 🤖 𝗻𝗮𝗻𝗼𝗰𝗼𝗱𝗲 𝗰𝗼𝗱𝗶𝗻𝗴 𝗮𝗴𝗲𝗻𝘁 but using #langchain4j ➕ #gemini

2 approaches:

1️⃣ AI service w/ all tools

2️⃣ multi-agent w/ specialized tools

Bonus: Web search & Markdown rendering

Helidon 4.4.0 Introduces Alignment with OpenJDK Cadence and Support via Java Verified Portfolio

Helidon 4.4.0 Introduces Alignment with OpenJDK Cadence and Support via Java Verified Portfolio

Oracle has released version 4.4.0 of Helidon, their microservices framework, featuring alignment with the OpenJDK release cadence, support via the new Java Verified Portfolio, new core capabilities, a

#AI can query your DB—but can it do it correctly? That’s the hard part. @MarcoBelladelli shows how #Hibernate + #Quarkus + #LangChain4j add validation & control back. Want fewer production surprises?

Dive in: https://javapro.io/2026/04/03/talk-to-your-data-natural-language-data-access-in-java/

Oracle has released #Helidon 4.4.0, bringing some major shifts to the framework:

• Now aligned with the OpenJDK release cadence

• Backed by the Java Verified Portfolio

• New agentic AI support via LangChain4j

• Packed with enhanced core capabilities

Dive into the full update here: https://bit.ly/4eaZGuS

What happens when one #AI call isn’t enough? You don’t add more prompts—you add agents. @kevindubois & Laura Cowen show how enterprise AI really scales.

Curious how production systems are built? Dive in: https://javapro.io/2026/03/31/agentic-ai-patterns-for-enterprise-software/

#Quarkus #LangChain4j #Microservices @QuarkusIO

Generate images at GPU speed—using Java. 🎨

At #ArcOfAI, Brian Benz from Microsft shows how to combine CUDA, ONNX Runtime & Stable Diffusion for Java with LangChain4j to build a real, cloud-ready image generation service.

https://www.arcofai.com/speaker/b60d427dd7e2473a96fe2523fa745915

🎟️ Tickets https://arcofai.com

#AI #LangChain4j #Java #Cloud #GenAI #MachineLearning #AustinTech #Developer #SoftwareEngineering

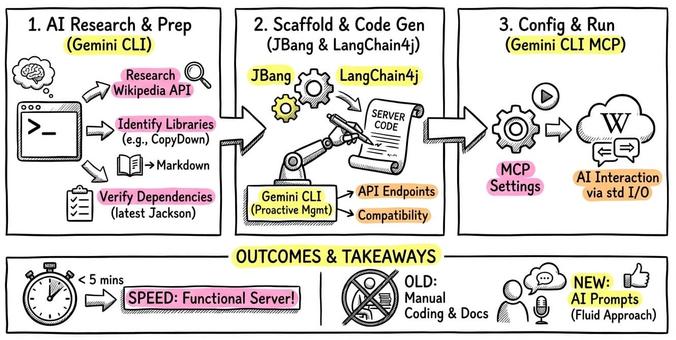

It still amazes me how easy & fast it is to create #MCP servers in #Java with #jbang, #langchain4j and a custom skill inside #geminicli

A handful of prompts, and less than 5 minutes later, I had created a working #Wikipedia MCP server!

https://glaforge.dev/posts/2026/04/02/creating-a-wikipedia-mcp-server-in-java-in-a-few-prompts/

AI in enterprise Java is powerful — but what about resilience & observability? #LangChain4J-CDI integrates with #MicroProfile Fault Tolerance & Telemetry out of the box. Buhake Sindi shows how to build #AI services ready for production: https://javapro.io/2026/02/25/bring-ai-into-your-jakarta-ee-apps-with-langchain4j-cdi-formerly-smallrye-llm/

@langchain4j