deinkoks

- 153 Followers

- 113 Following

- 101 Posts

Wenn ihr mal wieder ins Kino wollt, war gerade in "Der Astronaut" bzw. Project Hail Mary und das ist ne 9.9/10 ⭐

OH: “What is it about DNS that people find so difficult? It’s just cache invalidation and naming things.”

If SQL is pronounced "sequel" then surely DNS is pronounced "Dennis"?

Hahaha das ist ja perfekt

https://bahn.bet/

https://bahn.bet/

Das ist jetzt eine ganz schlechte Zeit, eine dumme Bundesregierung zu haben.

If you replace a junior with #LLM and make the senior review output, the reviewer is now scanning for rare but catastrophic errors scattered across a much larger output surface due to LLM "productivity."

That's a cognitively brutal task.

Humans are terrible at sustained vigilance for rare events in high-volume streams. Aviation, nuclear, radiology all have extensive literature on exactly this failure mode.

I propose any productivity gains will be consumed by false negative review failures.

Die Debatte um ein Mindestalter für Social Media geht am Problem vorbei: die Gefahren hören ja nicht mit 16 oder 18 auf - ganz im Gegenteil.

Der Vergleich zum Glücksspiel ist treffender, als diejenigen ahnen, die ihn verwenden:

* zutiefst korruptes Geschäftsmodell

* große Schäden für die Gesellschaft

* Mindestalter LEGITIMIERT das Geschäftsmodell und seine Opfer sind „selbst schuld.“

So wird der Missstand zementiert, statt an der Wurzel eliminiert.

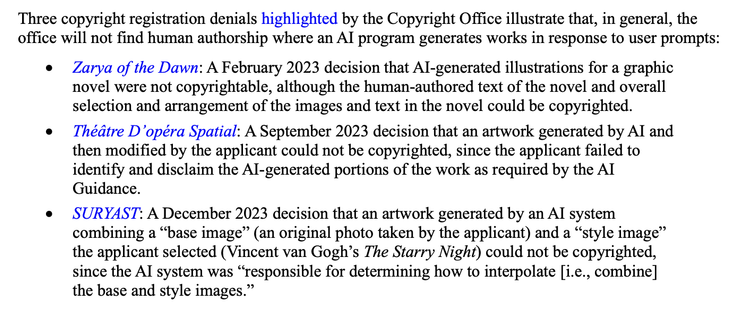

If you use AI-generated code, you currently cannot claim copyright on it in the US. If you fail to disclose/disclaim exactly which parts were not written by a human, you forfeit your copyright claim on *the entire codebase*.

This means copyright notices and even licenses folks are putting on their vibe-coded GitHub repos are unenforceable. The AI-generated code, and possibly the whole project, becomes public domain.

Source: https://www.congress.gov/crs_external_products/LSB/PDF/LSB10922/LSB10922.8.pdf

wir haben drei Paletten (120 Kisten) Muntermate die Ende April abläuft. sind hier Hackspace- oder Chaosevent-Menschen anwesend die gerne diese Mate trinken? Vielleicht können wir uns gegenseitig helfen.

https://premium-kollektiv.de/mate/

https://premium-kollektiv.de/mate/