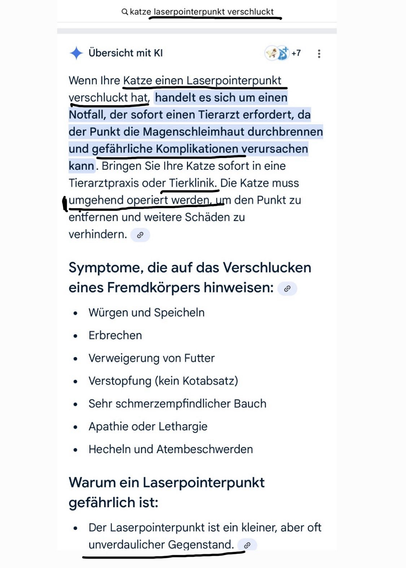

@derpostillon hats geschafft. #Gemini benutzt ihn jetzt auch als vertrauenswürdige Quelle.

@geeeero @superjan73 @agowa338 @derpostillon Das Problem hier ist, dass der Prozess fehlerhaft designt ist.

(und es ist mir klar, dass Google das so will, wegen seiner „Geschäftsziele“)

Gerade wenn ein LLM etwas zusammenfasst, sollte man darauf bestehen, dass es jede einzelne Behauptung mit Quellen belegt. Wegen Überprüfbarkeit und eben Quellenanalyse.

Dann gebe es aber keine Notwendigkeit, eine KI-Zusammenfassung zu produzieren, das "Ur-Produkt" würde reichen.I

@weirdfish @geeeero @superjan73 @agowa338 @derpostillon Sigh, ein LLM-basiertes System, besteht aus verschiedenen Komponenten. Ja, LLM „halluzinieren“ (wobei der Begriff irreführend ist, sie erzeugen einfach wahrscheinliche Tokens).

Mit den korrekten Prompts, den korrekten Werkzeugen, kommt man nicht in die Verlegenheit, dass das LLM anfängt, Tokens auszuspucken, primär basierend auf seinem Trainingswissen, sondern basierend auf dem korrekten Kontext.

@yacc143 @weirdfish @geeeero @superjan73 @derpostillon

Tja, aber wenn du "den korrekten Prompt" weißt, weißt du auch bereits was das Ergebnis ist...

@agowa338 @weirdfish @geeeero @superjan73 @derpostillon Nicht zwingend, der Punkt war, ich will keine Antwort von dem LLM aus „seinen Trainingsdaten“. Ich bevorzuge es bei weitem, dass das LLM einen Prozess orchestriert, wo es die Antwort findet und belegen kann.

Habe ich mir vor paar Wochen bei der Demo unseres CEO „wie ich AI nutze“ mir gedacht, der hat das cool gefunden, dass ChatGPT unsere Firma kennt. Ich habe mir gedacht nicht cool.

Weil das ein „Fakt“ ist, auf dem das Ding die Antwort aufbaut, das komplett ungeprüft ist. Es kann komplett erfunden sein. In diesem Fall war es cool weil alle im Call die Firma gekannt haben und auch aus dem Stehgreif kontrollieren konnten wer aktuell CEO ist.

Mein Punkt bezog sich darauf das LLM auf Schiene zu halten dass es brav Suchassistent spielt. "sinnvolle queries" entwirft, "beurteilt" welche Ergebnisse relevant sind, …