@derpostillon hats geschafft. #Gemini benutzt ihn jetzt auch als vertrauenswürdige Quelle.

@geeeero @superjan73 @agowa338 @derpostillon Das Problem hier ist, dass der Prozess fehlerhaft designt ist.

(und es ist mir klar, dass Google das so will, wegen seiner „Geschäftsziele“)

Gerade wenn ein LLM etwas zusammenfasst, sollte man darauf bestehen, dass es jede einzelne Behauptung mit Quellen belegt. Wegen Überprüfbarkeit und eben Quellenanalyse.

Dann gebe es aber keine Notwendigkeit, eine KI-Zusammenfassung zu produzieren, das "Ur-Produkt" würde reichen.I

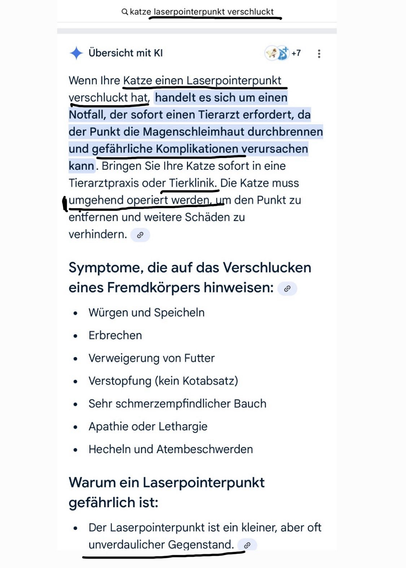

Ohne den restlichen Kontext zu kennen, wie query, und Resultate, kann es komplett sein, dass das LLM hier komplett korrekt das Top-Suchergebnis der „klassischen“ Suchengine zusammengefasst hat.

Dann sind wir bei Dingen wie der „Gemini App“, wo die Suchergebnisse gleich komplett weggelassen werden. Wenn da keine Quellenverweise nach jedem Absatz dabei stehen, dann kann man den Text gleich auf die Kippe werfen, wie will man wissen, ob das LLM das recherchiert, oder aus Trainingsdaten antwortet?

Statt einen Analyse eines Posts auf seinen Wahrheitsgehalt (mit Referenzen, die Fakten bestätigen oder widerlegen), 3 Absätze "Dave ich kann das jetzt für dich machen", wo das Ding erklärt, dass es ohne seine Werkzeuge zur Websuche, die in den Anweisungen geforderten Quellen nicht liefern kann.

Punkt ist, wer auf das Trainingsdaten-Wissen von LLM vertraut ist, kann genauso gut jedem menschlichen Quacksalber glauben.

Habe ich erwähnt, dass Menschen leider bei Menschen dazu neigen? (Der ganze Neoliberalismus z.B. hängt am rationalen Homo Oeconimicus sonst fallen alle ihre Gedankenspiele zusammen. Das Menschen aber nicht sonderlich rational sind haben Psychologen längst bewiesen, also wissenschaftlich korrekt, mit Studien, usw. Aber kein Mainstream-Okonom würde das jemals akzeptieren, die betrachten sich über normaler Wissenschaft.)

Also wieso sollten Menschen nicht auch LLM glauben?