Стресс-тест функций активации: GELU vs Tanh

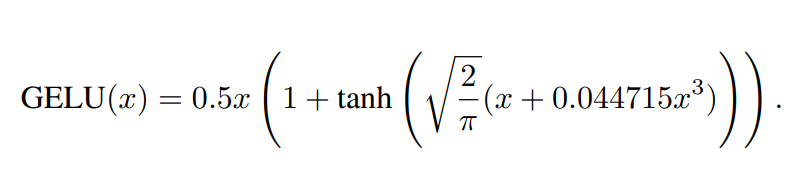

В современных нейросетях, включая LLM на базе Transformer, стандартом стали неограниченные функции активации — ReLU и GELU. Их основное преимущество, хорошая проходимость градиентов и быстрое обучение глубоких моделей. Однако на практике наблюдается проблема: при появлении доминирующих паттернов или высокочастотного шума во входном контексте (длинные диалоги, шумные данные, повторяющиеся или доминирующие токены) модели становятся нестабильными и склонными к деградации генерации и галлюцинациям. В этой статье я попытался выяснить, связан ли принципиально выбор функции активации с галлюцинациями LLM.