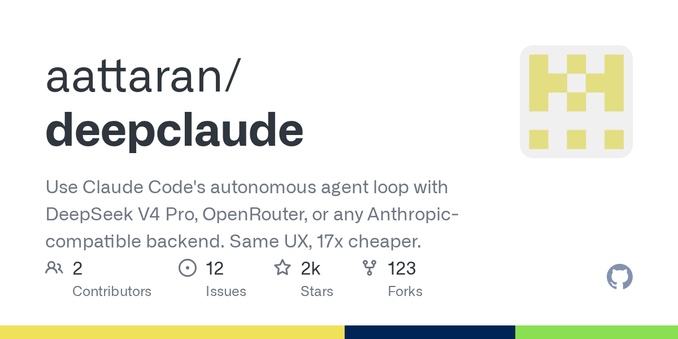

RT @DataChaz: Machst du dir bewusst, was hier passiert? 🚨 DEEPSEEK V4 PRO IST JETZT FÜR IMMER 75% GÜNSTIGER. Der neue König im Bereich Kosten pro Token. Input: $0,435 Output: $0,87 Cache: $0,0036 (fast kostenlos!) Wie? Das V4-Paper zeigt: Es wird nur 27% Rechenleistung und 10% Cache im Vergleich zu v3.2 benötigt. 👀↓ DeepSeek (@deepseekai) Wir machen unseren Rabatt dauerhaft! 🎉 Nutzt DeepSeek-V4-Pro zum Bauen und bringt eure innovativen Ideen zum Leben! 🚀 — https://nitter.net/deepseekai/status/2057854261699195173#m

mehr auf Arint.info

#AI #CostEfficiency #DeepSeek #Innovation #MachineLearning #TechNews #arint_info