AssemblyAI (@AssemblyAI)

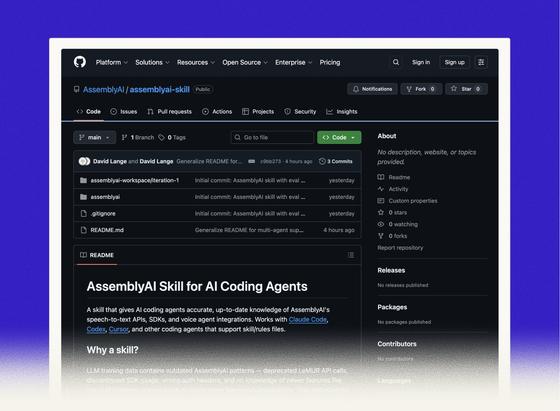

코딩 에이전트는 API 변화가 빠를 때 성능이 떨어질 수 있는데, 최근 여러 기능과 모델을 출시했다고 알립니다. 발표된 항목으로 Universal-3 Pro Streaming, Universal-3 Pro, 그리고 LLM Gateway 등이 있으며, 이는 최신 기능을 반영한 개발자용 모델/인프라 업데이트임을 시사합니다.

https://x.com/AssemblyAI/status/2033514383914283118

#universal3 #llmgateway #modelupdate #streaming #codingagents

AssemblyAI (@AssemblyAI) on X

The best coding agents still need a little help when your API is moving faster than their training data. We've shipped a lot in the last few months: Universal-3 Pro Streaming, Universal-3 Pro, and LLM Gateway to name a few. Features that simply postdate what most coding agents