@greblus

- 2 Followers

- 21 Following

- 17 Posts

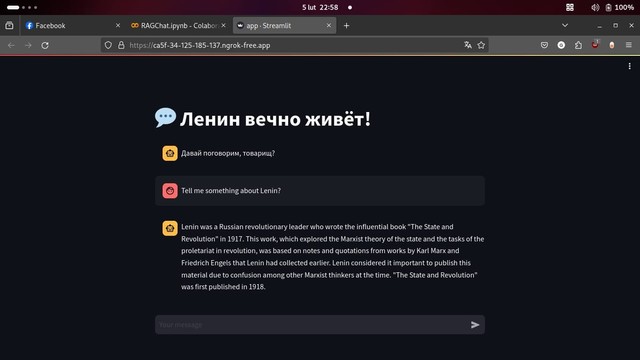

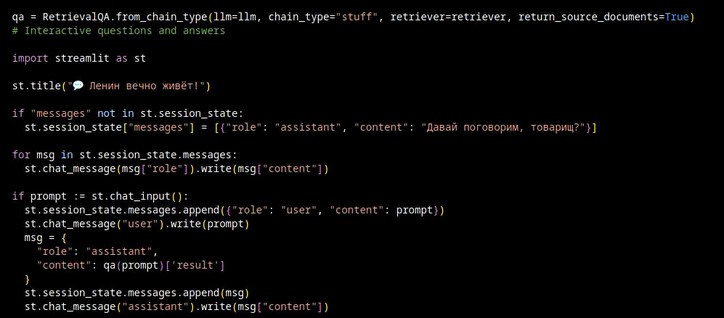

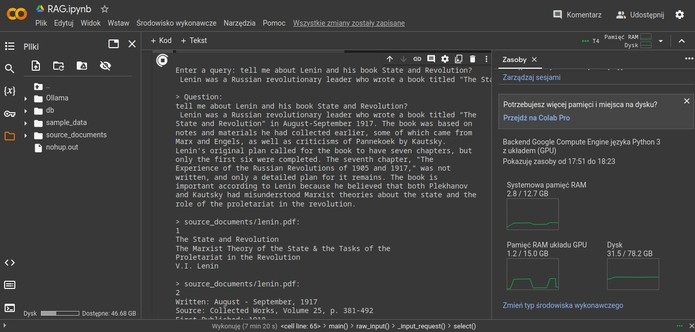

Jest i RAGChat. Genialny jest Streamlit, cały kod to raptem kilka linijek w Pythonie 😉

Mój pierwszy RAG (Retrieval Augmented Generation) z Mistralem 7B na Google Colab. Nie ma wielkich wymagań i nawet się na tego Lenina nie obraził 😉

O Czacie GPT słyszał już prawie każdy, a o Mistralu i Mixtralu, czyli MoE (Mixture of Experts) pewnie nadal nie tak wielu. Jest lepszy od GPT, Open Source i można go odpalić lokalnie, albo na serwerach Google Colab ;-) (dla Mixtral 8x7B, NV Tesla T4 w darmowej wersji Colab, to trochę za mało, 7B działa super).

Ocenzurowany przez OpenAI model nie odpowie na każde pytanie, a Dolphin nie dość że lepszy, to można go "douczyć".

Planowałem dokształcić go dziełami Lenina, ale to byłoby okrutne...

Moje pierwsze kroki z Mastodon i ActivityPub są całkiem obiecujące. Próba re-postowania z Hubzilli wpisu o większej ilości znaków niż 500 powiodła się 😉. Drogą prób i błędów doszedłem, że do Hubzilli trzeba dodać ActivityPub Protocol w linku "Brakuje funkcji -> Zainstaluj więcej aplikacji".

Fajnie, jakby to działało w standardowej konfiguracji. Inna sprawa, że 500 znaków to za mało nawet, żeby dobrze opisać wypróżnienie (nigdy nie lubiłem Tłitera).

Dziś cyfra jest w muzyce wszędzie. W gitarze wszystkie te Fractale, AxeFX-y i QuadCortex-y brzmią genialnie, ale mają jedną wadę - głośnik gitarowy ma inną charakterystykę i wpięcie w system audio, nawet z dobrą symulacją kolumny to nadal nie to samo. W domowych warunkach powietrze się nie rusza 🙂, a ja zawsze chciałem "odcyfrzyć" cyfrę. Wymyśliłem eksperyment z NAM Neural Amp Modeller.

Aby wrócić z sygnałem z laptopa do wzmacniacza konieczny jest reamp-box, bo trzeba dopasować impedancję, typ i poziom sygnału z interfejsu audio do wejścia wzmacniacza gitarowego. Ale przeczytałem gdzieś, że wystarczy jakikolwiek pedał z buforem i jeśli na wejście damy sygnał z interfejsu audio to przy odpowiednim ustawieniu głośności na wyjściu będzie sygnał akceptowalny dla wzmacniacza.

Ma być tak tanio, jak się da, czyli wykorzystujemy co mamy: Poweramp 5mm EHX (2.5W to bardzo dużo, ja go ustawiam na godzinę 9:00), 12-letniego laptopa na Linuksie, wtyczkę NAM w Ardour, M-Audio Fast Track USB (równie wiekowy) i Mojomojo jako pierwsze w pedalboardzie:

FT->MM-> PowerAmp->odpięty od wzmacniacza Celestion Greenback G12H w moim combo Laneya.

Jak to pięknie gra z perfekcyjnymi modelami Tone King Imperiala, czy Fender Bassmana z 1964 roku udostępnionym za darmo przez Amalgam Captures Studio:

https://www.amalgamcaptures.com/nam

Ale na tonehunt.org jest tego na ten moment 6596. No i wreszcie mam swoją Mesę Dual Rectifier, która nie ma jak się zepsuć i nie kosztuje 15kPLN.

Zmontuje reamp-boxa z czystej ciekawości. Choćby rozłączanie masy (ground lift) może się przydać, ale do uzyskania całkowicie przekonujących wyników wystarczy to co na zdjęciu. Latencja w Ardour 6ms, CPU Load ~65%, bez dodatkowych wtyczek (wolę pedalboard). To gra i reaguje (dynamika, artykulacja, itp) jak prawdziwy sprzęt.

W przyszłości zbuduję paczkę gitarową na jakimś fajnym 12" głośniku i być może będzie to mój docelowy sprzęt do hałasowania w domu. A NAM można już dziś uruchomić na Raspberry Pi 4 z obsługą przez footswitch via MIDI, ale myślę, że stary laptop ma większy urok (zero-waste).

#linux #guitar #NAM

Aby wrócić z sygnałem z laptopa do wzmacniacza konieczny jest reamp-box, bo trzeba dopasować impedancję, typ i poziom sygnału z interfejsu audio do wejścia wzmacniacza gitarowego. Ale przeczytałem gdzieś, że wystarczy jakikolwiek pedał z buforem i jeśli na wejście damy sygnał z interfejsu audio to przy odpowiednim ustawieniu głośności na wyjściu będzie sygnał akceptowalny dla wzmacniacza.

Ma być tak tanio, jak się da, czyli wykorzystujemy co mamy: Poweramp 5mm EHX (2.5W to bardzo dużo, ja go ustawiam na godzinę 9:00), 12-letniego laptopa na Linuksie, wtyczkę NAM w Ardour, M-Audio Fast Track USB (równie wiekowy) i Mojomojo jako pierwsze w pedalboardzie:

FT->MM-> PowerAmp->odpięty od wzmacniacza Celestion Greenback G12H w moim combo Laneya.

Jak to pięknie gra z perfekcyjnymi modelami Tone King Imperiala, czy Fender Bassmana z 1964 roku udostępnionym za darmo przez Amalgam Captures Studio:

https://www.amalgamcaptures.com/nam

Ale na tonehunt.org jest tego na ten moment 6596. No i wreszcie mam swoją Mesę Dual Rectifier, która nie ma jak się zepsuć i nie kosztuje 15kPLN.

Zmontuje reamp-boxa z czystej ciekawości. Choćby rozłączanie masy (ground lift) może się przydać, ale do uzyskania całkowicie przekonujących wyników wystarczy to co na zdjęciu. Latencja w Ardour 6ms, CPU Load ~65%, bez dodatkowych wtyczek (wolę pedalboard). To gra i reaguje (dynamika, artykulacja, itp) jak prawdziwy sprzęt.

W przyszłości zbuduję paczkę gitarową na jakimś fajnym 12" głośniku i być może będzie to mój docelowy sprzęt do hałasowania w domu. A NAM można już dziś uruchomić na Raspberry Pi 4 z obsługą przez footswitch via MIDI, ale myślę, że stary laptop ma większy urok (zero-waste).

#linux #guitar #NAM

Jako alternatywę do Big Muff Germanium 4 zmontowałem klona Fuzz Factory od Musikding, jeden z najciekawszych efektów gitarowych jaki widziałem. Wg schematu kondensator C2 to 100nF (0.1uF). Zmieniłem na 680nF. Wow! Można ten układ wprowadzić w oscylację, która brzmi jak gitara basowa. Pierwszy stopień, tranzystor Q1 (2N3904) zamieniłem na germanowy AC176K NPN, dwa pozostałe to też germanowe AC125 PNP. Dzięki temu efekt ma mnóstwo basu, górę i warczący distortion.

Mówią, że jak się zrobi pierwszy fuzz, to potem jest już z górki. To mój trzeci 🎛️