Meine Heizung kann ich heute auslassen – die AMD 9070 XT übernimmt das! 🔥

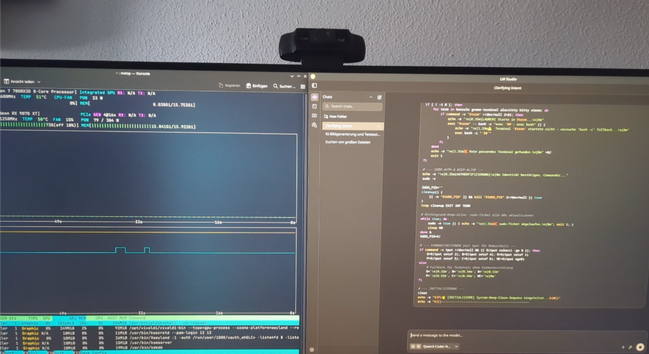

Habe heute endlich meine eigene KI lokal auf Linux mit LM Studio aufgesetzt. Beeindruckend zu sehen, wie die Hardware unter Last arbeitet, aber die Unabhängigkeit von der Cloud ist es wert. 🐧💻

Hostet ihr eure LLMs auch schon selbst oder nutzt ihr noch Cloud-Anbieter? Welches lokale Modell ist euer Favorit? 👇

#SelfHosted #Linux #AI #AMD #Radeon #Privacy #OpenSource #LMStudio #LocalAI #KI

Habe heute endlich meine eigene KI lokal auf Linux mit LM Studio aufgesetzt. Beeindruckend zu sehen, wie die Hardware unter Last arbeitet, aber die Unabhängigkeit von der Cloud ist es wert. 🐧💻

Hostet ihr eure LLMs auch schon selbst oder nutzt ihr noch Cloud-Anbieter? Welches lokale Modell ist euer Favorit? 👇

#SelfHosted #Linux #AI #AMD #Radeon #Privacy #OpenSource #LMStudio #LocalAI #KI