Kimi.ai (@Kimi_Moonshot)

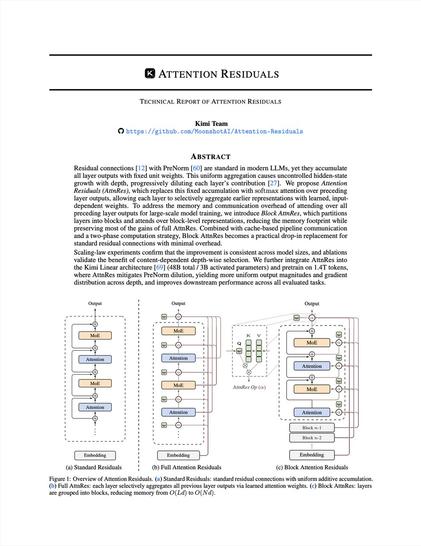

Attention Residuals를 소개하는 연구 발표로, 기존의 고정된 잔차 연결(depth-wise accumulation)을 재검토하고 표준 depth-wise recurrence를 대체하는 새로운 접근을 제시합니다. 시간과 깊이의 이중성에 영감을 받아 심층 신경망의 깊이별 집계 방식을 재설계하는 내용입니다.

Kimi.ai (@Kimi_Moonshot) on X

Introducing 𝑨𝒕𝒕𝒆𝒏𝒕𝒊𝒐𝒏 𝑹𝒆𝒔𝒊𝒅𝒖𝒂𝒍𝒔: Rethinking depth-wise aggregation. Residual connections have long relied on fixed, uniform accumulation. Inspired by the duality of time and depth, we introduce Attention Residuals, replacing standard depth-wise recurrence with