Das ist so cool.

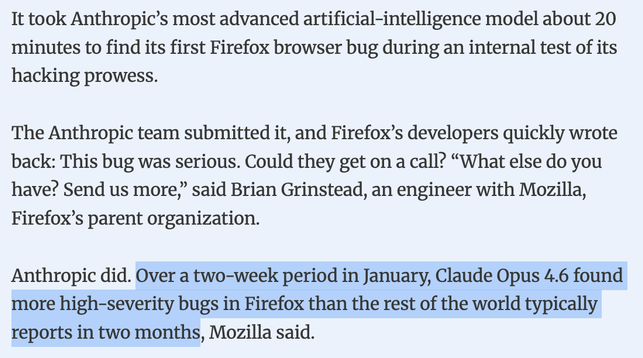

"In the two weeks it was scanning, Claude discovered more than 100 bugs in total, 14 of which were considered “high severity.” That means that if the right “exploit code” had been created, they could have been used in a widespread attack on Firefox’s users."

https://www.wsj.com/tech/ai/send-us-more-anthropics-claude-sniffs-out-bevy-of-bugs-c6822075?ref=platformer.news via the Overspill https://theoverspill.blog/2026/03/11/british-ai-investment-mystery-start-up-2627/