Akshay (@akshay_pachaar)

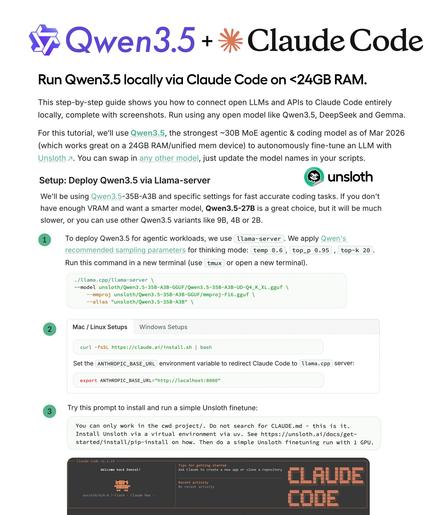

Claude Code가 로컬 LLM을 백엔드로 사용하도록 지원한다고 안내함. 환경변수 ANTHROPIC_BASE_URL을 로컬 llama.cpp 서버로 지정하면 Claude Code가 모든 요청을 해당 로컬 모델로 라우팅하여 API 비용 없이, 데이터가 머신을 벗어나지 않게 로컬에서 실행 가능하도록 설계되었다.

Akshay 🚀 (@akshay_pachaar) on X

Run Claude Code using local LLMs for FREE. No API costs. No data leaving your machine. Here's how it works: Claude Code lets you swap its backend via a single env variable. Point `ANTHROPIC_BASE_URL` to a local llama.cpp server, and it'll route all requests to whatever model