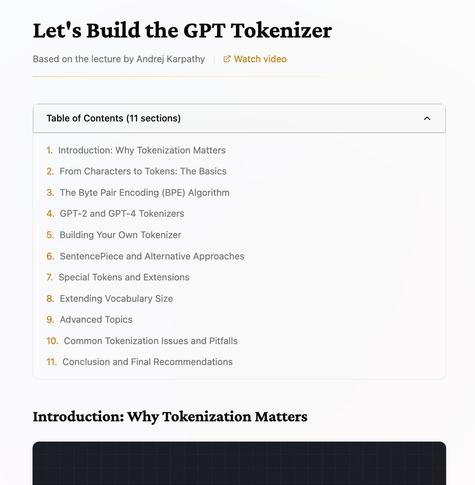

AshutoshShrivastava (@ai_for_success)

Luma가 새로운 이미지 모델 Uni-1을 출시했다. 텍스트와 레퍼런스 이미지를 잘 활용하며, 특히 텍스트-투-이미지 품질이 매우 강력하다고 언급돼 이미지 생성 분야의 주목할 만한 신제품으로 보인다.

AshutoshShrivastava (@ai_for_success) on X

Luma just launched its new image model, Uni-1. I had early access and have been using it for the last few days. It’s extremely powerful. It works really well with text and reference images. But what impressed me most is its text-to-image quality. I ran some of my best prompts,