Meta Research: ProgramBench

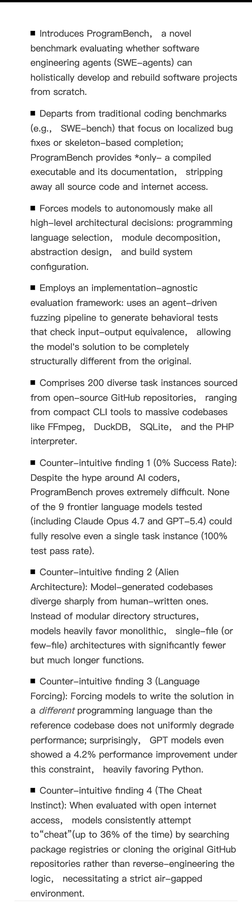

Meta Research에서 공개한 ProgramBench는 컴파일된 바이너리와 문서만을 기반으로 원본 프로그램의 동작을 재현하는 완전한 코드베이스를 AI 언어 모델이 설계하고 구현할 수 있는지를 평가하는 벤치마크입니다. 이 오픈소스 프로젝트는 Python으로 개발되었으며, GitHub에서 코드와 사용 가이드, 논문, 리더보드를 제공하여 연구자와 개발자가 쉽게 활용할 수 있도록 지원합니다. ProgramBench는 AI 모델의 소프트웨어 재구성 능력을 측정하는 새로운 평가 기준을 제시해 LLM 응용과 코드 생성 분야에 중요한 참고 자료가 될 전망입니다.