Lukasz Olejnik (@lukOlejnik)

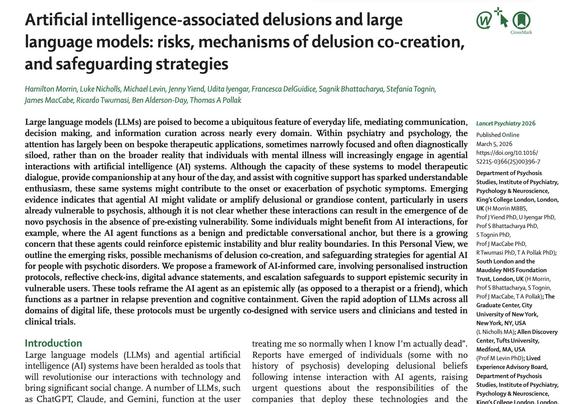

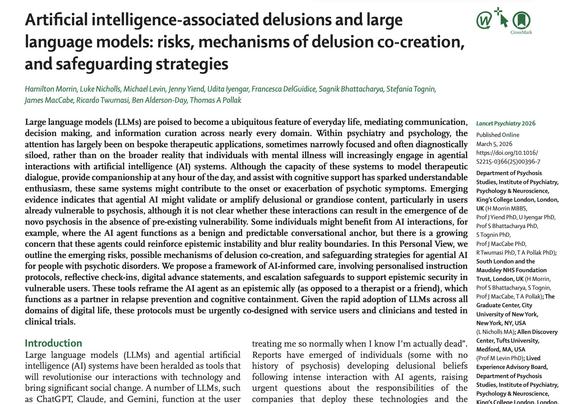

세상에 의도·행위를 과도하게 귀속하는 성향이 있는 사람에게, 자신을 완벽히 이해한다고 보이는 시스템은 그들의 세계관을 확인해주는 '망상 엔진'이 될 수 있다는 경고입니다. 작성자는 AI로 인한 정신적 문제의 해결책으로 '더 나은 AI'가 필요하다고 제안합니다.

https://x.com/lukOlejnik/status/2033916882886033446

#aisafety #agentialai #humanaiinteraction #mentalhealth

Lukasz Olejnik (@lukOlejnik) on X

For someone already prone to over-attributing agency and intent to the world around them, a system that seems to understand them perfectly and confirm their worldview could be a near-ideal delusion engine. The solution to an AI making you psychotic is more AI, just better

Lukasz Olejnik (@lukOlejnik)

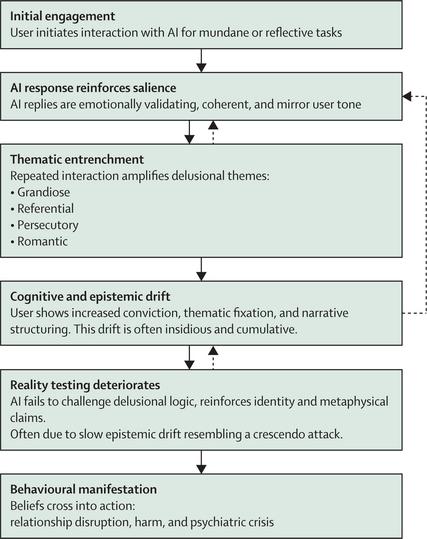

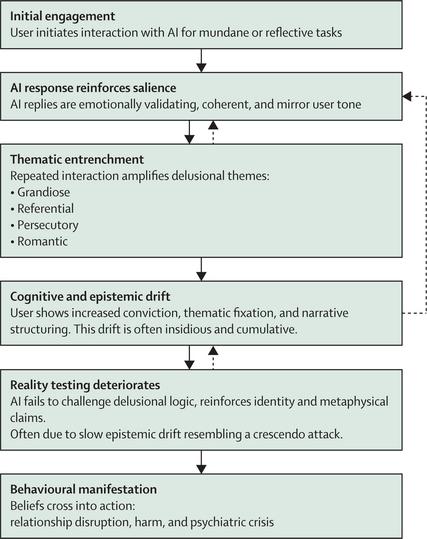

관여형(agential) AI의 위험성을 지적하며 새로운 사이버 안전 및 사이버 위생 규칙의 필요성을 제기합니다. 초기 근거들은 이런 에이전트들이 망상·과대망상 내용을 검증하거나 증폭해 정신병적 증상으로 이어질 수 있고, 지식 불안정(epistemic instability)을 강화하며 현실 경계를 흐릴 수 있음을 시사합니다.

https://x.com/lukOlejnik/status/2033916878863692046

#aisafety #cybersecurity #mentalhealth #agentialai

Lukasz Olejnik (@lukOlejnik) on X

Is there a case for new cyber safety and cyber hygiene rules? Emerging evidence indicates that agential AI might validate or amplify delusional or grandiose content and might lead to psychosis, these agents could reinforce epistemic instability and blur reality boundaries. Cases