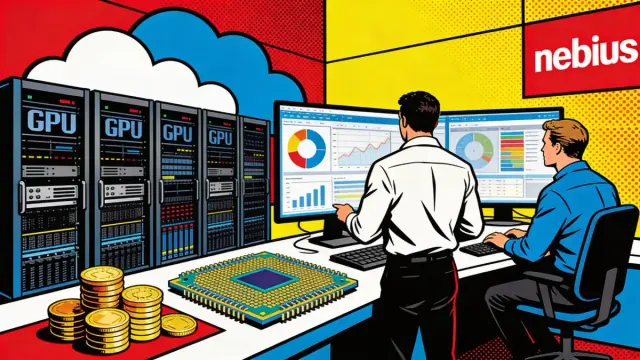

Nebius acquires California-based Eigen AI for $643M, bringing the 20-person inference optimization team into its Token Factory service. The deal reflects broader industry shift toward managed AI services beyond raw GPU rentals. Follows earlier Tavily acquisition as Nebius pairs software buys with data center expansion.

#AI #CloudComputing #InferenceOptimization

https://www.implicator.ai/nebius-buys-eigen-ai-for-643-million-to-strengthen-token-factory/

Nebius Buys Eigen AI for $643M to Boost Token Factory

Nebius agreed to buy Eigen AI for about $643 million, bringing a 20-person inference-optimization team into Token Factory as the neocloud tries to move beyond GPU rentals and into higher-value production AI services. The deal follows Tavily and a rapid data center buildout.