JD

- 35 Followers

- 15 Following

- 1.2K Posts

Climate deniers celebrate that the IPCC worst case scenario has been declared unlikely and scream out loud that the apocalypse has been cancelled and that "climate change religion" has finally been exposed as fake.

Yay, current climate action will likely save us from 4-6 degrees of warming 🎉

That's only reason to truly celebrate if one never really understood what 2+ degrees of warming will look like.

The stupidity pandemic is in full swing.

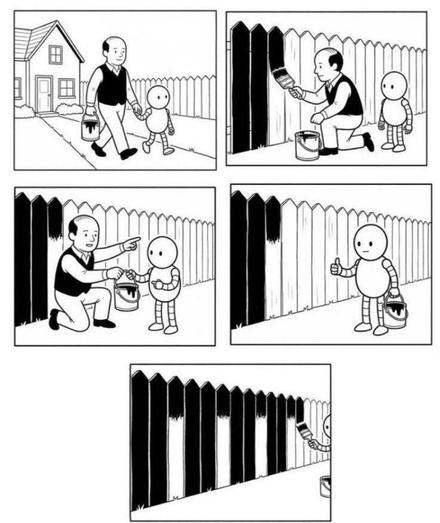

Members of Congress trading stocks is insider trading

Plain and simple

Ban congress people from trading stocks, as simple as that 🤷 If they want to trade stocks, don't go into f-ing congress

A toddler even understands this

RE: https://techhub.social/@Techmeme/116596312742431654

This is the dumbest fucking thing I’ve read since the last AI thing.

RE: https://dice.camp/@strangequark/116589330360597820

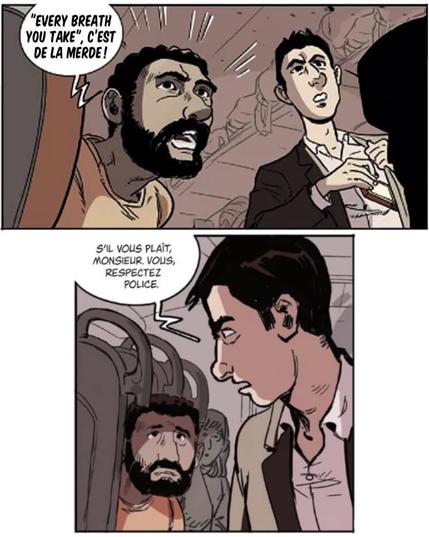

On ne conseillera jamais assez @12train à chaque fois que c'est possible...

🚨 Le Média doit atteindre 10 000 donateurs mensuels avant le 30 juillet. Sa survie en dépend.

À l’approche de 2027, voir disparaître l’un des rares médias télévisés indépendants et engagés serait un signal alarmant.

Chaque soutien compte 🙏