OpenAIの新たなAIモデル「GPT-4o」は、人間のようにリアルタイムにテキスト、音声、写真を分析して返答でき、Siriを原始的に見せる

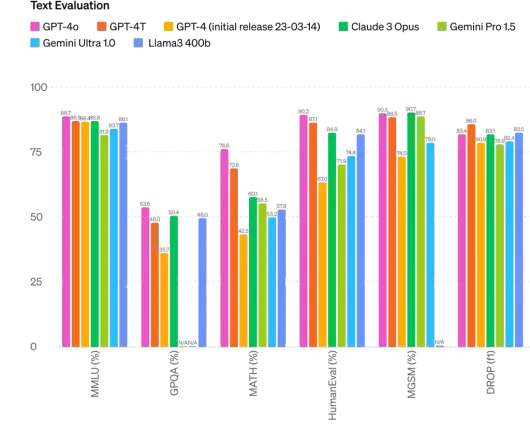

OpenAIは本日オンラインイベントを開催し、オーディオ、ビジョン、テキストを“リアルタイム”で推論できる新たな基幹モデルである「GPT-4o」(oはOmniを表す)を発表した。ネーミングからすると、OpenAIの中でこれはGPT-4の漸進的なバージョンアップという位置づけかも知れないが、その進化はパフォーマンスと効率性において新たな基準を打ち立てるものでもある。 https://www.youtube.com/watch?v=DQacCB9tDaw テキスト、ビジョン、オーディオの入出力を同じニューラルネットワークで処理する初めてのモデル これまでのトップレベルのモデルだったGPT-4 […]