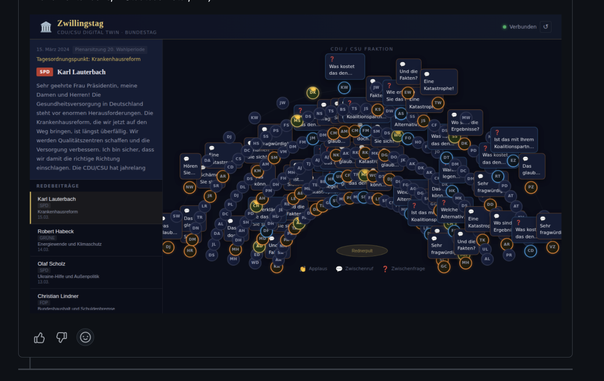

So als digitaler Zwilling des Bundestags.

So als digitaler Zwilling des Bundestags.

Lets build it: https://github.com/LilithWittmann/Zwillingstag/pull/1

Vibe coding only.

[WIP] Add CDU behavior simulation for parliament debate by Copilot · Pull Request #1 · LilithWittmann/Zwillingstag

Create backend (Python/FastAPI) CDU/CSU member profiles (static JSON, ~40 members) Bundestag DIP API integration (with mock fallback) LLM service for reaction generation (OpenAI, configurable) ...

Aber danach unbedingt darauf beharren das niemals gesagt zu haben, und bei Beweisen springt ein Dritter bei und beschützt das Plappermaul mit einer klugen Aussage wie „Kollegin xy is mit der Maus ausgerutscht, das kann jedem mal passieren“

Das ist aber eine sehr niedrige Barriere.

Kann ja gar nicht sein. Hat doch nicht mal 10 M€ gekostet

Den Output stelle ich mir extrem langweilig vor. ;)

Aber selbst wenn, damit die Inferenz stattfinden kann muss doch das Training vorausgegangen sein.

@0x4261756D Erstmal rechnen die da nicht mit den R&D Strom sondern mit dem reinen Trainingsstrom. Das teure ist aber R&D um herauszufinden, wie man das Model trainiert. Sie kommen dann auf die 0.3 watt hours, pro message. Die auch jede Google-Suche auslöst.

Das Ding ist halt, jedem Post die ich hier schreibe triggert garantiert ein AI-Model beim VS. Da finde ich es schon okay ab und zu meine free credits zu verballern - wenn ich stattdessen meinen Nachmittag nicht mit googlen verbracht hab 🤪.