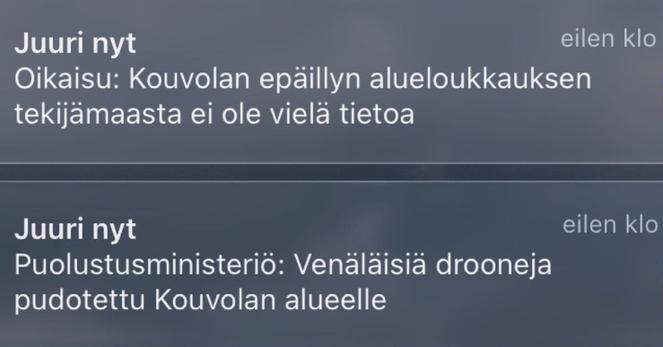

Det här är livsfarligt. Journalister på Finlands största tidning Helsingin Sanomat litade på en felaktig AI-sammanfattning av pressmeddelandet från Försvarsministeriet och publicerade en nyhet där det framgick att man skulle ha skjutit ner ryska drönare i Kouvola. Detta trots att drönarna inte var ryska och inte hade skjutits ner.

Ska man verkligen använda ett verktyg som hittar på falska nyheter?

Hmm, samma felaktiga nyhet publicerades även i kvällstidningen Ilta-Sanomat, som ingår i samma koncern och använder samma AI-verktyg.

Päätoimittajalta: Pyydämme anteeksi vakavaa virhettä https://www.is.fi/kotimaa/art-2000011913249.html

Den felaktiga rubriken var inte helt entydig. Det går att läsa som "ryska drönare skjutits ner" eller "ryska drönare fälldes". Men i sammanhanget läste jag automatiskt det "skjutits ner", för "fälldes" är ologiskt. Fälldes varifrån då?

@kallekn ja, det är dystra utsikter. Jag har inte lyckats hitta någon vinkel på hur man ska tänka runt det här. Inget kommer att vara sant i framtiden (deepfake för foto och film etc).

Men det känns som att borde finnas någon slags tanke att formulera runt det här och hur det kommer att balanseras upp av någon annan utveckling. Den tanken undgår mig dock ännu.

Det skrämmande för mig är hur många som verkar tro att gen AI ger ifrån sig fakta. Det gör den inte. Den har inte en susning om fakta

LLMer fungerar inte helt olikt mänskliga hjärnor. Fundera själv över hur du gör för att veta vad som är fakta.

Ingen som använt en LLM som programmeringshjälpmedel tror längre på att det de numera uppnår "bara" är sannolikhetsberäkningar på nästa token - även om det är just det som händer. Något mer än så har uppstått när de gått över en viss storlek.

Helt rätt är dock att aldrig använda en LLM som en databas. Precis som vi slår upp information i trovärdiga källor behöver de göra det för att man ska nå vettiga resultat.

är allt annat än jag expert på det här. Kan väldigt lite. Men... min erfarenhet är att du måste både förbereda det du matar in (prompt, context) väldigt väl och med viss skicklighet/vana för att få ett gott resultat OCH besitta rätt förmåga/kunskap för att bedöma om resultatet är värdefullt eller bara strunt. Finns säkert undantag. Men generellt mitt intryck. Man kan alltså inte använda det för saker man inte själv förstår sig på tillräckligt för att kunna bedöma resultatet

Bloggade precis lite om detta, hur - den helt korrekta - kommentaren att LLMer bara utför statistik på mest sannolika efterföljande token trots allt verkar ge upphov till något "mer". Använder ett riktigt exempel från en fråga jag ställde min programmeringshjälpreda i dag:

@leanderlindahl @kallekn Här är en intressant rapport från BBC och EBU just om AI för nyhetsnotiser, 41% av notiserna i studien hade ”at least one significant issue”.

https://www.bbc.co.uk/mediacentre/2025/new-ebu-research-ai-assistants-news-content

@leanderlindahl @kallekn Samma fenomen dyker upp vid översättning, 404media skriver om hur Wikipedia fick problem med felaktigheter i LLM-översatta artiklar.

https://www.404media.co/ai-translations-are-adding-hallucinations-to-wikipedia-articles/

När det blir rätt beror det på att träningsmaterialet har ett stort antal förekomster av "rätt". T ex om nån frågar vad är Sveriges huvudstad, eller säger skriv ett javascript som itererar över den här array:en. Men om det finns för lite "rätt" i träningsmaterialet så fogar den samma annat som "låter rätt" ändå. S k hallucination.

@kallekn Det är ju tyvärr så här chattbottarna fungerar. Äldre sammanfattningssystem kunde också göra fel, men baserade sig helt på ursprungstexten, så felen var normalt av typen att den kombinerade ihop fel saker eller utelämnande något viktigt.

Chattbottbaserade sammanfattningssystem fungerar enligt en helt annan princip: hitta på innehåll som är troligt enligt vad som brukar skrivas, löst baserat på ursprungstexten. Resultatet blir därefter.