#ai #minisforum Зато почти ничего не тормозит, но это не точно....

@hardworm Ебать... А физических ядер сколько? 16?

@hardworm Еще и памяти 128гб... А видюха дискретная? Что там воткнуто?

@cauf встройка.

Графическая модель

Графическая карта Radeon 8060S

Количество графических ядер

40

Частота графического отображения

2900 МГц

Графическая модель

Графическая карта Radeon 8060S

Количество графических ядер

40

Частота графического отображения

2900 МГц

@hardworm Мммм... Вот была бы еще какая-нибудь 5060 с 16гб - пряям вообще секс для нейроразвлечений

@cauf так она и так для нейроразвлечений. Он может быть быстрей 5060. (от размера модели завист)

@hardworm там же тензорных ядер нет, по идее. Или компенсируется невьебенным процем? Вроде как Проц медленнее

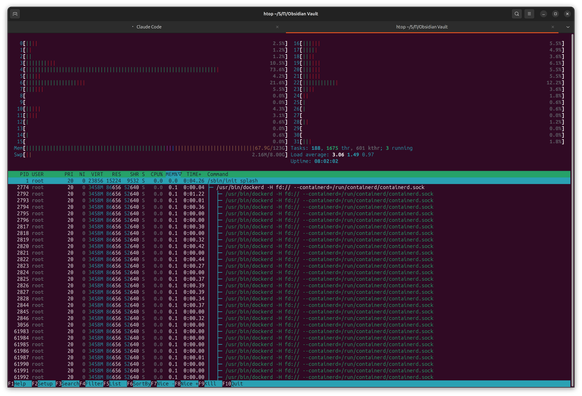

@cauf я хз чем. 5060 на маленьком контексте на мелкой модели в x2 быстрее. Чем больше давать контекста\модель тем медленнее. А тут так не падает скорость. И на условной glm-4.7-flash:latest будет выдавать 67 т\с

Сейчас еще скачаю gpt-oss-120b попробую....

@hardworm @cauf ему cpu offload не жмёт, туда сюда данные не гоняет, изначально в медленной памяти сидит модель, но хоть не прыгает туда сюда между ram/vram. Скорее всего разогнана оперативка чтобы медленность компенсировать. В проц зашили пару инструкций, чтобы перемножать матрицы и вуаля - инференс таки тащит. Условно, всё, что больше 20b с контекстом выше стандартного 4к токенов тут летает шустрее, чем у меня на rtx5060ti16g. И это я про кванты q4. А @hardworm теперь bf16 боярин, походу.