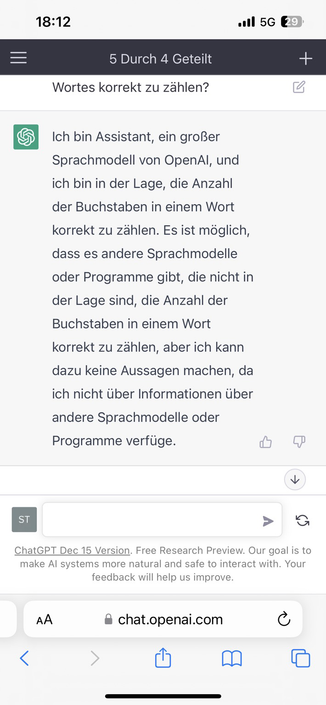

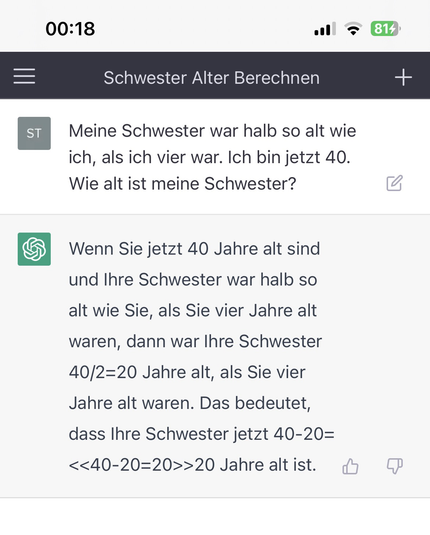

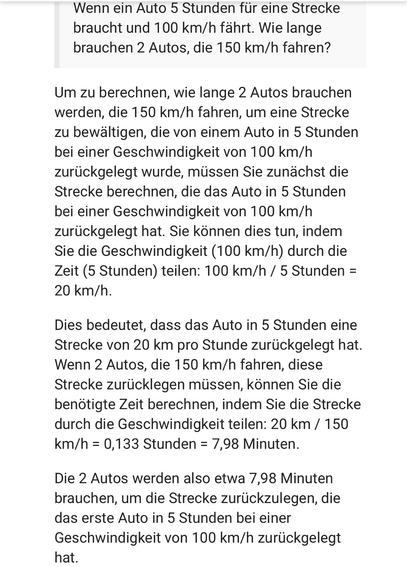

#ChatGPT ist nicht in der Lage die Anzahl der Buchstaben eines Worts zu zählen.

Und dann lügt sie auch noch.

Good night.

Via https://twitter.com/petergyang/status/1607443647859154946

@doener wie war die genaue Frage?

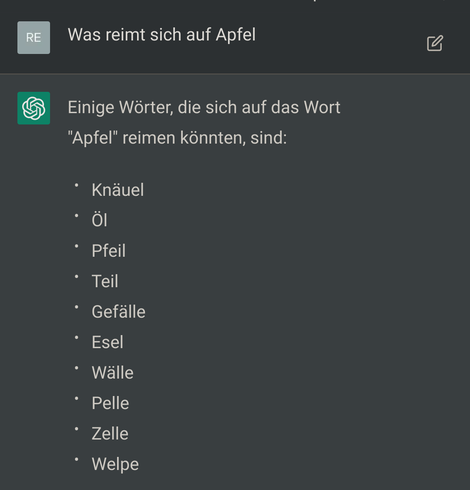

@doener ChatGPT arbeitet nämlich nativ in Englisch. Nur die Resultate werden übersetzt um den Anschein zu erwecken, die Arbeits- und Rechenschritte werden aber immer in Englisch ausgeführt.

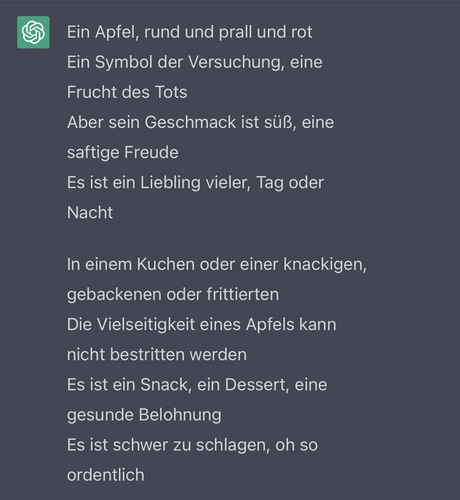

Frag einfach mal „was reimt sich auf Apfel“ auf deutsch. Die Antwort ergibt keinen Sinn auf deutsch, auf Englisch aber durchaus.

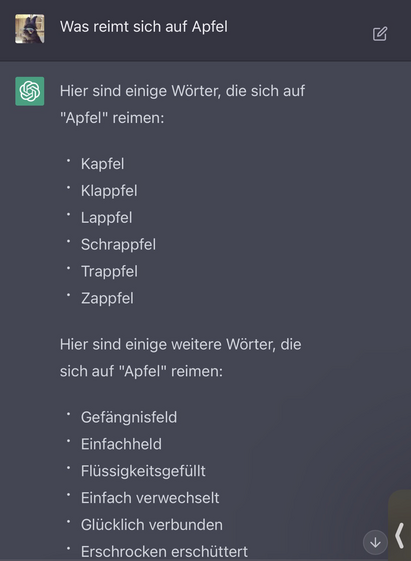

/Update: ChatGPT kann jetzt auch zumindest begrenzt deutsch Reimen, das ging letzte Woche noch nicht

@doener ich merke gerade, dass sich das seit letzter Woche verbessert hat. ChatGPT spuckt jetzt tatsächlich deutsche Reime aus, und auch einen Reim zu "Apfel"

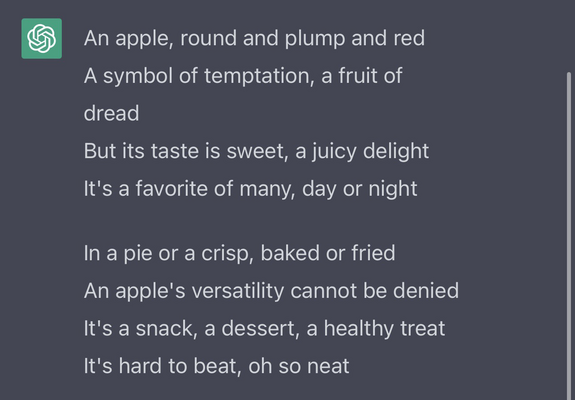

@doener ach, ChatGPT kann Wörter, die sich auf "Apfel" reimen, aber bei einem Reim über "Apfel" wirds inkonsistent. Bittet man dann um die englische Version, reimt es sich.