MitM-прокси для LLM

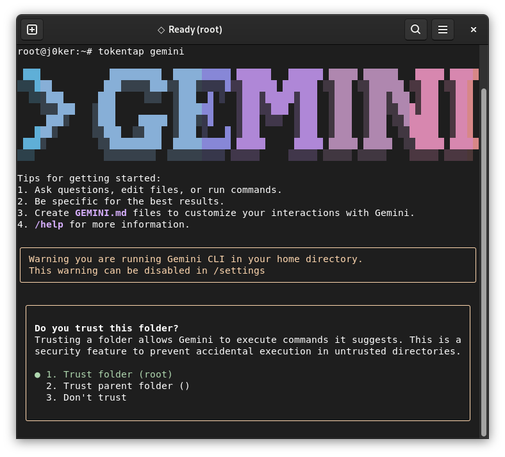

Многие разработчики в последнее время используют облачные LLM для генерации программного кода, в том числе с помощью агентов. Но это вызывает как минимум две проблемы: Утечка информации: мы не знаем, какие данные LLM передаёт в облако Бесконтрольный расход токенов, особенно в случае автоматических агентов, которые запускаются в автономную работу на длительный период Для этого есть специальные инструменты мониторинга. Например, Tokentap (бывший Sherlock) отслеживает использование токенов для LLM CLI в реальном времени на панели в консоли. Такой MitM-прокси полезен для информационной безопасности и просто для учёта расходов.

https://habr.com/ru/companies/globalsign/articles/1016612/

#MitM #Hugging_Face #llamaccp #ggml #Local_AI #Gemini_CLI #Claude_Code #OpenAI_Codex #mitmproxy #HTTPSпрокси