𝑳𝒂 𝒉𝒆𝒓𝒐𝒊́𝒏𝒂 𝒐𝒍𝒗𝒊𝒅𝒂𝒅𝒂

𝑳𝒂 𝒉𝒆𝒓𝒐𝒊́𝒏𝒂 𝒐𝒍𝒗𝒊𝒅𝒂𝒅𝒂

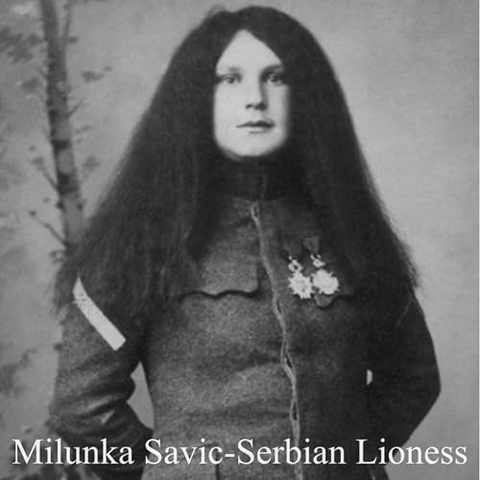

Cuando Milunka Savić volvió de la guerra, llevaba el cuerpo lleno de cicatrices y el pecho cubierto de medallas.

Había sobrevivido a algunas de las campañas más brutales de Europa, había capturado soldados enemigos ella sola y era admirada por oficiales de distintos países.

Aun así, terminó limpiando oficinas para poder alimentar a su familia.

Nació en una aldea campesina de Serbia y en 1912 tomó una decisión que cambiaría su vida para siempre: se cortó el cabello, se vistió como hombre y se presentó en el ejército serbio usando el nombre de su hermano, Milun Savić.

Quería ocupar su lugar en la Primera Guerra Balcánica y sabía que, siendo mujer, jamás la aceptarían oficialmente.

Entró en combate y muy pronto destacó por algo imposible de fingir: el valor.

Participó en enfrentamientos extremadamente duros contra el Imperio Otomano y después continuó luchando durante la Segunda Guerra Balcánica.

La verdad salió a la luz cuando fue herida en combate.

Durante la atención médica descubrieron que el soldado Milun era en realidad una mujer.

Sus superiores quedaron sorprendidos y le ofrecieron trasladarla al cuerpo de enfermería, que era el destino considerado “adecuado” para una mujer en aquella época.

Milunka se negó.

Quería seguir combatiendo como soldado y, después de ver su historial en el frente, el ejército aceptó algo completamente excepcional para su tiempo: permitirle permanecer en unidades de combate.

Durante la Primera Guerra Mundial participó en algunas de las campañas más sangrientas del ejército serbio.

En la batalla de Kolubara realizó una acción que se volvió legendaria: logró capturar ella sola a veinte soldados austrohúngaros.

Fue herida al menos nueve veces a lo largo de su carrera militar.

Sobrevivió a explosiones, ofensivas, retiradas desesperadas y años de guerra constante en un continente destruido.

Las condecoraciones comenzaron a acumularse.

Recibió la Croix de Guerre francesa con palma de oro, una distinción extremadamente rara y que la convirtió en la única mujer de la historia en obtenerla.

También recibió dos Legiones de Honor francesas, la Cruz de San Jorge rusa, medallas británicas y múltiples reconocimientos serbios.

Hoy se la considera una de las mujeres combatientes más condecoradas de toda la historia militar.

En Francia la admiraban tanto que le ofrecieron instalarse allí con una pensión cómoda y estabilidad económica.

Pero Milunka rechazó la propuesta.

Decidió quedarse en Serbia, el país por el que había estado dispuesta a morir.

La paz, sin embargo, fue mucho más cruel con ella que la guerra.

En 1923 se casó con Veljko Gligorijević, un hombre más joven al que conoció en Mostar.

Poco después nació su única hija biológica, Milena, pero el matrimonio terminó en divorcio.

Veljko abandonó prácticamente a la familia y Milunka quedó sola criando a su hija.

Aun así, siguió ayudando a otros.

Adoptó a tres niñas huérfanas y además colaboró en la crianza y alimentación de muchos niños pobres de su vecindario.

Quienes la conocieron hablaban de una mujer dura, reservada y extremadamente generosa.

Mientras Europa olvidaba lentamente a sus veteranos, ella sobrevivía como podía.

Trabajó como costurera, cocinera y finalmente pasó alrededor de veinte años limpiando oficinas en el Banco Hipotecario de Belgrado.

Resulta difícil no sentir amargura al imaginar la escena: la misma mujer ante la que habían saludado generales y oficiales extranjeros fregando suelos para llegar a fin de mes.

Su situación se volvió tan precaria que veteranos y periodistas comenzaron a denunciar públicamente el abandono en el que vivía una de las mayores heroínas de Serbia.

Solo entonces, ya anciana y enferma, recibió un pequeño apartamento en Belgrado en 1972.

Disfrutó de él apenas un año.

El 5 de octubre de 1973, Milunka Savić murió a los 81 años tras sufrir un accidente cerebrovascular.

Fue enterrada inicialmente en una tumba familiar, lejos del reconocimiento que merecía.

La justicia llegó tarde otra vez.

En 2013, cuarenta años después de su muerte, Serbia trasladó sus restos con honores de Estado al Paseo de los Grandes del Nuevo Cementerio de Belgrado.

Hoy tiene calles con su nombre y es recordada como símbolo de valentía, resistencia y dignidad.

La historia de Milunka duele porque recuerda algo incómodo: muchos héroes son admirados mientras sirven para la guerra, pero olvidados cuando llega la paz.

Ella nunca pidió privilegios ni fama.

Solo siguió adelante, incluso cuando el mundo dejó de mirar.

▣▣▣▣▣▣▣▣▣▣▣▣▣▣▣▣▣▣

#historia #primeraguerramundial #milunkasavić #serbia #mujeresenlahistoria #guerrasbalcánicas #heroína #historiareal #memoriahistórica #mujeresvalientes #curiosidadeshistóricas #soldados #belgrado